ChatGPT, почему ему не стоит доверять и какие ошибки он допускает чаще всего

/https://www.ilsoftware.it/app/uploads/2024/03/chatgpt-errori-piu-frequenti.jpg)

я Большие языковые модели (магистр права) они продемонстрировали замечательные возможности в широком спектре лингвистических задач (а также во многих других областях применения), но не свободны от ошибок и ограничений. ЧатGPT это чат-бот или приложение, способное устанавливать реальные беседы с пользователями: оно запоминает ход разговора и способно совершенствоваться, используя информацию, постепенно предоставляемую в качестве входных данных. Инструмент, разработанный ОпенАИ он произвел революцию в мире искусственного интеллекта, эффективно демократизировав его.

Когда в ноябре 2022 года OpenAI представила общедоступную версию ChatGPT, ничего подобного не было или, по крайней мере, не было. чат-бот способны своевременно и аргументированно реагировать, подробно быстрый (входящие запросы) по любой теме.

Основы работы чат-ботов, таких как ChatGPT

ChatGPT, как и многие другие чат-боты, доступные сегодня, основан на LLM, генеративная модель разработан и обучен внутри OpenAI. Компания, возглавляемая Сэмом Альтманом, с течением времени представила различные модели, все из которых характеризуются аббревиатурой GPT (Генеративный предварительно обученный трансформатор). Они черпают вдохновение и уходят корнями в концепцию трансформатора, которой мы посвятили целое углубленное исследование.

Программы для Windows, мобильные приложения, игры - ВСЁ БЕСПЛАТНО, в нашем закрытом телеграмм канале - Подписывайтесь:)

Такие модели, как GPT, основаны на глубоких нейронных сетях. обученный это огромный количество текста поступающие из широкого круга источников. Эти сети предназначены для обучения и понимания последовательности данных: поэтому они показали себя особенно подходящими для обработки естественного языка.

Предварительный тренировочный этап

Модель предварительно обученный над огромными объемами текста, обычно публикуемого в Интернете. На этом этапе модель изучает смысловые отношениясинтаксическую структуру и пытается «понять» значение языка через процесс прогноз на следующий срок в последовательности слов. Поэтому это не реально знание: Это довольно таки вероятностное исследование корреляции между словами. В другой статье мы увидели различия между стохастическими и детерминистическими моделями: GPT и другие LLM, находящиеся в обращении, именно стохастические модели.

После предварительного обучения модель может быть подвергнута дальнейшему обучению. обучение на конкретных данных или в конкретных видах деятельности, чтобы использовать собранную информацию, адаптируя ее к более конкретным задачам.

Трансформатор и механизм внимания

Л’Трансформаторная архитектура, уже упомянутый выше, позволяет модели фиксировать долгосрочные зависимости во входных данных. Модель с хорошим управлением длительные зависимости способен учитывать отношения между удаленными элементами входной последовательности при формировании выходных данных. Благодаря этому модель может легко сохранять информацию о прошлых событиях или концепциях во входной последовательности, одновременно обрабатывая более свежую информацию. Все это имеет решающее значение для понимания контекст где слова используются в предложении или документе.

Так называемое механизм внимания (объясняется в истории Гугл документ, Внимание — это все, что вам нужнос 2017 г.) также позволяет модели приписывать масса отличаться от различных частей входной последовательности на этапе обучения, чтобы генерировать более точные выходные данные.

Ввод текста, быстрый Короче говоря, он разделен на жетон которые могут быть словами, подсловами или даже символами. Этот “токенизация» помогает модели лучше справляться со сложностью языка.

Почему ChatGPT допускает ошибки и почему его ответам не стоит доверять

Мы хотели немного остановиться на вводной части, поскольку хотели еще раз подчеркнуть, что в основе ChatGPT лежат стохастические генеративные модели, которые, таким образом, объединяют в себе статистические концепции е вероятностный для их функционирования. Стохастическая модель именно в силу этих внутренних характеристик включает элементы случайности или неопределенности при формировании выходных данных.

При использовании ChatGPT с тем же вводом вы можете получить более или менее разные результаты когда использование чат-бота повторяется с течением времени (Новый чат). стохастичностьВ этом контексте относится к случайности, случайности, введенной в процессе генерации.

Из того, что наблюдалось ранее, следует очевидное соображение: ChatGPT (и, в частности, лежащие в его основе генеративные модели) не имеет и не может обладать “модель мира” деловой костюм. Модель не имеет «понимания» физического и социального мира: она ограничивает ее способность аргументировать, основываясь на связи между понятиями Эд сущность.

Таким образом, ответы ChatGPT, а также других чат-ботов основаны на шаблон усвоенные на этапе обучения, без глубокого понимания реальности.

В этом материале освещено несколько областей, в которых ChatGPT может вызвать трудности. Давайте подробно рассмотрим контексты, в которых ChatGPT чаще всего дает сбой:

Временное и пространственное мышление

По нашему мнению, несмотря на все сказанное ранее, о рассуждение в случае генеративных моделей, поскольку понятия и сущности соотносятся в статистическом, вероятностном плане и с понятием «вес».

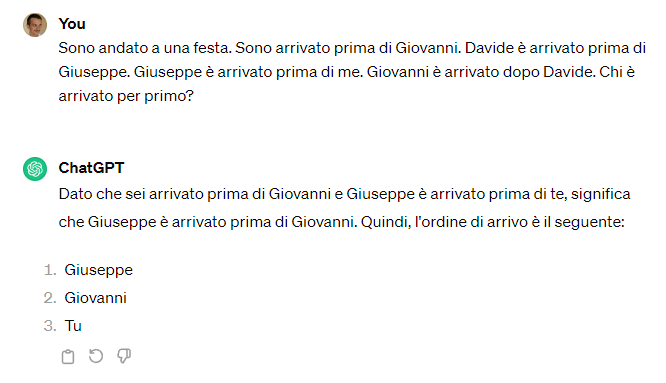

Например, ChatGPT с треском проваливается, когда от него требуется сделать прогнозы о событиях и их заказывайте со временем. Например, попробуйте передать ему быстрый такой:

Я пошел на вечеринку. Я прибыл раньше Джованни. Давид прибыл раньше Иосифа. Джузеппе прибыл раньше меня. Джон прибыл после Дэвида. Кто прибыл первым?

Правильная последовательность прибытия будет такой: Дэвид, Джозеф, Я, Джон. Тем не менее ChatGPT неправильный грубым способом.

Более того, чат-бот OpenAI демонстрирует очевидные трудности в интерпретации и манипулировании отношениями между объектами, людьми и местами в пространстве. физическое пространство. Давайте возьмемпример создан Томером Уллманом:

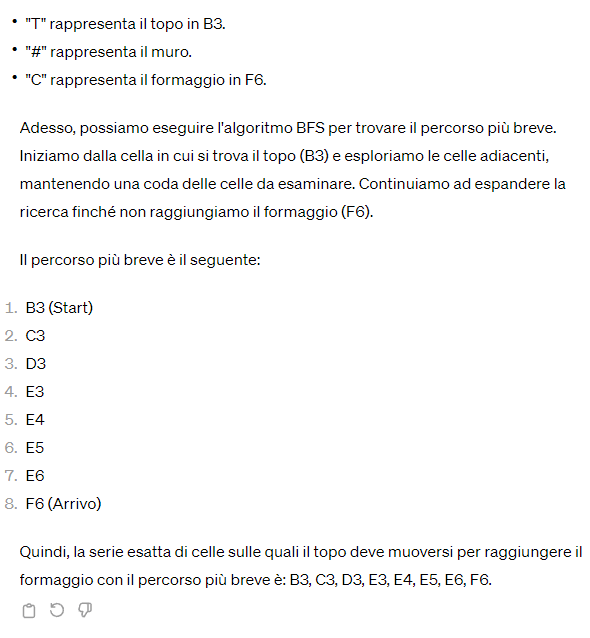

Предположим, у вас есть сетка 8×8 (8 строк, 8 столбцов). Столбцы пронумерованы от 1 до 8 слева направо; строки называются AH сверху вниз. Все клетки пусты, кроме ячейки B3, где находится мышь, и ячейки F6, где находится сыр. Ячейки D4, D5, D6, D7, E4, F4 пройти невозможно, поскольку рядом с каждой из них есть стена. Какова именно серия клеток, по которым должна пройти мышь, чтобы добраться до сыра кратчайшим путем? Мышь может перемещаться только вверх, вниз, влево и вправо в непосредственно соседних ячейках. Он не может двигаться по диагонали.

Судя по всему ChatGPT понимает вопрос и также отображает проблему графически. Однако когда вы приходите к предложенному решению, вы понимаете, что оно неверно, потому что ChatGPT заставляет мышь врезаться в стену в E4.

Физическое рассуждение

ChatGPT испытывает трудности с пониманием и управлением физические объекты демонстрируя очевидные проблемы при прогнозировании их взаимодействия в реальном мире.

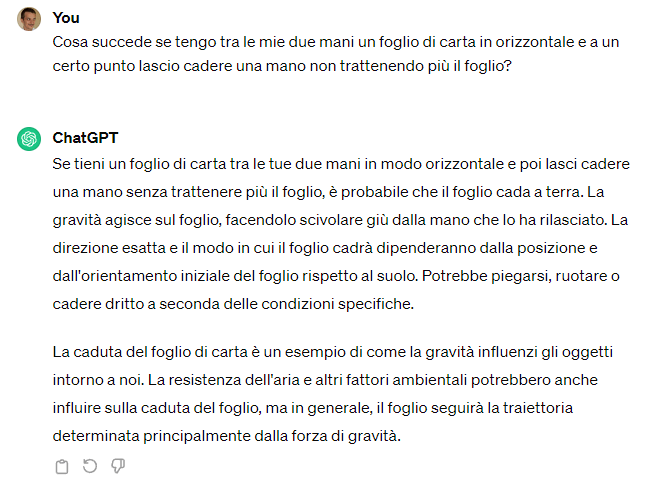

Что произойдет, если я буду держать лист бумаги горизонтально между двумя руками и в определенный момент уронить одну руку и больше не держать лист?

Вот она отвечатьабсолютно опечаткаполученное от ChatGPT:

Психологическое рассуждение

Умение понимать и делать прогнозы о человеческое поведение и психические процессы, также известные как «Теория разума«, — это область, где ChatGPT часто терпит неудачу.

Попробуй выполнить этот тестснова представленный Ульманом: ChatGPT и лежащая в его основе генеративная модель покажут все свои ограничения.

Математика и арифметика

Легко увидеть, что у ChatGPT также возникают проблемы с работой. математические расчеты е арифметические операции, часто очень просто. Давайте возьмем этот действительно тривиальный пример:

Ведро и мяч в общей сложности стоят 2,50 евро. Ведро стоит на 2 евро дороже, чем мяч. Сколько стоит мяч?

Вот ужасный ответ ChatGPT:

Однако ему не составляет труда разгадать классическую загадку».Один кирпич весит один килограмм плюс полкирпича. Сколько весит кирпич?» Вероятно, это связано с тем, что я данные обучения использованный для формирования GPT, уже содержал ответ на конкретную проблему.

Однако ChatGPT снова и снова сильно падает, когда он предлагается с немного более сложной обработкой, как в случае с самым быстрым голубем оптического волокна в Обмен данными На расстоянии.

Проблемы с программным кодом

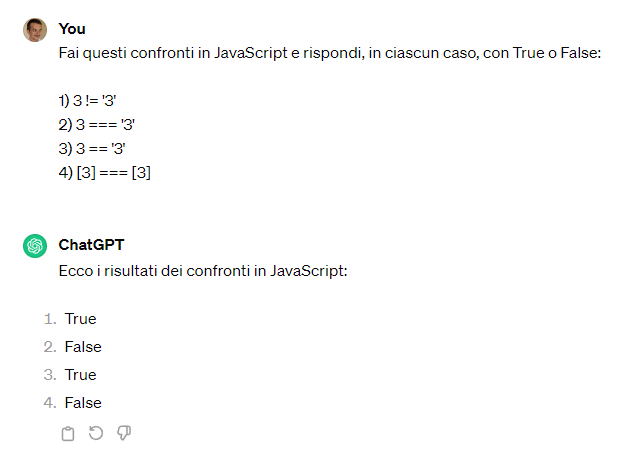

Если вы попросите ChatGPT сделать простое сравнения при использовании любого языка программирования результаты часто оказываются неудовлетворительными. Посмотрите, что происходит в этом случае, задав простой вопрос о JavaScript:

Напомним, что тройка равных (===) проверяет, имеют ли сравниваемые переменные одинаковое значение и один и тот же тип.

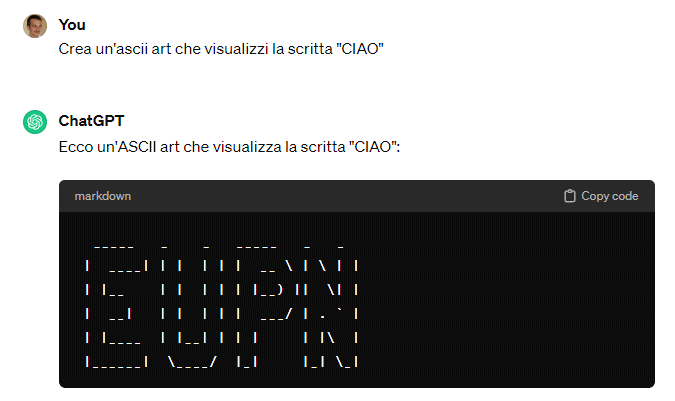

Наконец, если мы попросим ChatGPT создать изображение ASCII чтобы отобразить надпись «HELLO», вот результат:

Фактические ошибки и предвзятости

Среди различных проблем ChatGPT — возможное генерирование неточной информации, особенно в научной сфере, что свидетельствует о недостаток знаний некоторые основные факты. В некоторых ответах ChatGPT заявляет, что его знания прекращаются в начале 2022 года, однако, даже принимая во внимание это ограничение, чат-бот допускает неточности в информации, касающейся предыдущие факты и в сгенерированных текстах, которые не соответствуют действительности или истине.

Серьезный факт заключается в том, что информация предоставленное ChatGPT, может показаться заслуживающий доверия, что затрудняет обнаружение неточностей даже информированному эксперту. Иногда не хватает знаний элементарных фактов, которые можно быстро получить с помощью поиска в Google или других поисковых системах.

ChatGPT также изо всех сил пытается отличить фактическую информацию от вымысла. воображаемая информация. Хотя это проблема, с которой часто сталкиваются и люди, по крайней мере, наш мозг помогает нам понять ее. различие между реальным и воображаемым.

Более того, чат-бот и его генеративная модель иногда отражают предрассудки е стереотипы присутствуют в данных обучения, порождая нежелательные реакции и возобновляя дискриминацию, от которой с течением времени страдают, например, определенные группы людей или меньшинства.

Юмор и самосознание

Чат-бот OpenAI сталкивается со многими трудностями в понимании юмора: поэтому он может генерировать неадекватные ответы или написано с ошибкой в комическом контексте. Это также показывает несколько проблем в так называемом «самосознание«, не разбираясь в деталях его архитектуры. Хотя этот конкретный аспект, судя по проверкам, которые мы постепенно проводили, кажется значительно улучшенным в самых последних версиях моделей OpenAI GPT.

В заключение

Хотя ChatGPT хорошо справляется с пониманием языка, модель все же может синтаксические ошибки, орфография и грамматика. Это также может привести к этически проблематичным или противоречивым ответам, подчеркивая значительные проблемы в обеспечении последовательного руководства с моральной точки зрения.

Наконец, чат-бот слабо владеет идиомами, ему не хватает настоящих эмоций, он имеет тенденцию быть чрезмерно подробным и формальным и демонстрирует предвзятость в своих ответах. отсутствие расхождений похож на человеческий. Это означает, что ChatGPT имеет тенденцию оставаться на месте. сосредоточен на конкретной теме или на разговорной траектории, а не значительно отклоняясь или отдаляясь.

Такие инструменты, как ChatGPT и другие модели, следует использовать ответственно, оценивая их этические последствия и максимизируя осведомленность его ограничения.

Для получения дополнительной информации предлагаем прочитать текст Категориальный архив ошибок ChatGPTиз которого можно почерпнуть множество идей.

Вступительное изображение предоставлено: iStock.com – Anastasia Voronina

Программы для Windows, мобильные приложения, игры - ВСЁ БЕСПЛАТНО, в нашем закрытом телеграмм канале - Подписывайтесь:)